11 апреля 2026

ИИ и поиск по знаниям компании: как повысить точность ответов

Автор: ТЕХЛАБА

Коротко (TL;DR)

- Корпоративный поиск по знаниям в 2026 перестал быть «удобной функцией» и стал операционной инфраструктурой: от его точности зависят скорость решений, качество поддержки и нагрузка на экспертов.

- Главный источник ошибок — не модель, а знания: устаревшие документы, дубли, слабая структура, отсутствующие владельцы и неочевидные права доступа.

- Точность ответов растет, когда поиск строится как система: clean data, retrieval + rerank, цитирование источников, confidence-гейты и регулярная оценка на реальных вопросах.

- Практический путь внедрения: 90-дневный цикл с базовой картой источников, пилотом на одном домене, метриками качества и операционным процессом обновлений.

Содержание

- Почему поиск по знаниям стал критичным в 2026

- От «корпоративного поиска» к answer-системе

- Где теряется точность: 7 типовых причин

- Архитектура точного knowledge-поиска

- Данные и governance: фундамент качества

- Retrieval и rerank: как реально поднимать релевантность

- Контроль качества ответов и уменьшение галлюцинаций

- Безопасность и доступ: кто должен видеть какие знания

- Метрики: как измерять точность и бизнес-эффект

- План внедрения на 90 дней

- Чеклист команды

- Итог и FAQ

Почему поиск по знаниям стал критичным в 2026

В большинстве компаний знания распределены по десяткам систем: wiki, CRM, таск-трекеры, email, базы инцидентов, проектные папки, внутренние чаты, продуктовая документация, юридические регламенты. Формально информация «есть», но фактически сотрудники тратят много времени на поиск, перепроверку и уточнение у коллег.

В 2026 эта проблема стала особенно заметной по двум причинам. Первая — скорость изменений: продуктовые и процессные правила обновляются чаще, и устаревшая информация быстрее превращается в операционный риск. Вторая — рост сложных межфункциональных задач, где нужно быстро собрать контекст из разных доменов, а не из одного документа.

Когда точного поиска нет, организация платит сразу в нескольких местах:

- медленнее принимаются решения;

- растет нагрузка на экспертов, которым постоянно задают одни и те же вопросы;

- увеличивается число ошибок из-за старых или неполных данных;

- новые сотрудники дольше выходят на продуктивность.

Именно поэтому «поиск по знаниям» в 2026 рассматривают не как удобство, а как инфраструктуру качества. Если система отвечает неточно или не объясняет, откуда взят ответ, доверие команды быстро падает и эффект от внедрения исчезает.

От «корпоративного поиска» к answer-системе

Классический корпоративный поиск выдавал список документов. Современная модель — answer-first: пользователь ожидает короткий релевантный ответ, ссылки на источники и возможность углубиться в детали. Это уже другой уровень требований к системе.

Что изменилось

- От «найти файл» к «получить проверяемый вывод».

- От текстового совпадения к семантической релевантности.

- От статичного индекса к постоянному обновлению знаний.

- От универсального доступа к ролевому доступу с аудитом.

Почему это важно для бизнеса

Answer-система сокращает time-to-answer и снижает «контекстные потери». Сотрудник не тратит 20–40 минут на ручной ресерч, а получает ответ с источниками за минуты. Это особенно критично для поддержки клиентов, продаж, инцидент-менеджмента, compliance и продуктовых команд.

Где начинаются проблемы

Если answer-система не умеет отказывать при нехватке данных, не умеет указывать источники и не учитывает права доступа, она становится генератором уверенных, но рискованных ответов. Поэтому зрелый корпоративный поиск должен строиться как управляемый контур, а не как чат над «сырым» архивом документов.

Где теряется точность: 7 типовых причин

1. Устаревшие документы в индексе

Если система не различает актуальные и архивные версии, она может выдавать устаревшие правила как действующие. Это одна из самых частых причин ошибок.

2. Дубли и конфликтующие источники

Один и тот же процесс описан в нескольких местах разными словами. Без governance retrieval берет «случайный» вариант, и ответ становится непоследовательным.

3. Слабая структура документов

Длинные неструктурированные тексты плохо индексируются на уровне смысловых блоков. Система видит «массив текста», но теряет точный контекст.

4. Отсутствие owner у знаний

Если у раздела нет владельца, никто не отвечает за актуализацию. В итоге качество постепенно деградирует без явного сигнала.

5. Неверный chunking

Слишком крупные фрагменты добавляют шум, слишком мелкие теряют смысловые связи. Оптимальный режим нужно подбирать по домену.

6. Нет rerank и quality-валидации

Простой retrieval без переоценки кандидатов часто поднимает «почти релевантные» документы выше нужных, особенно на сложных запросах.

7. Игнорирование прав доступа

Даже точный ответ становится проблемой, если пользователь получает данные, которые не должен видеть. Без role-aware retrieval система не готова к продакшену.

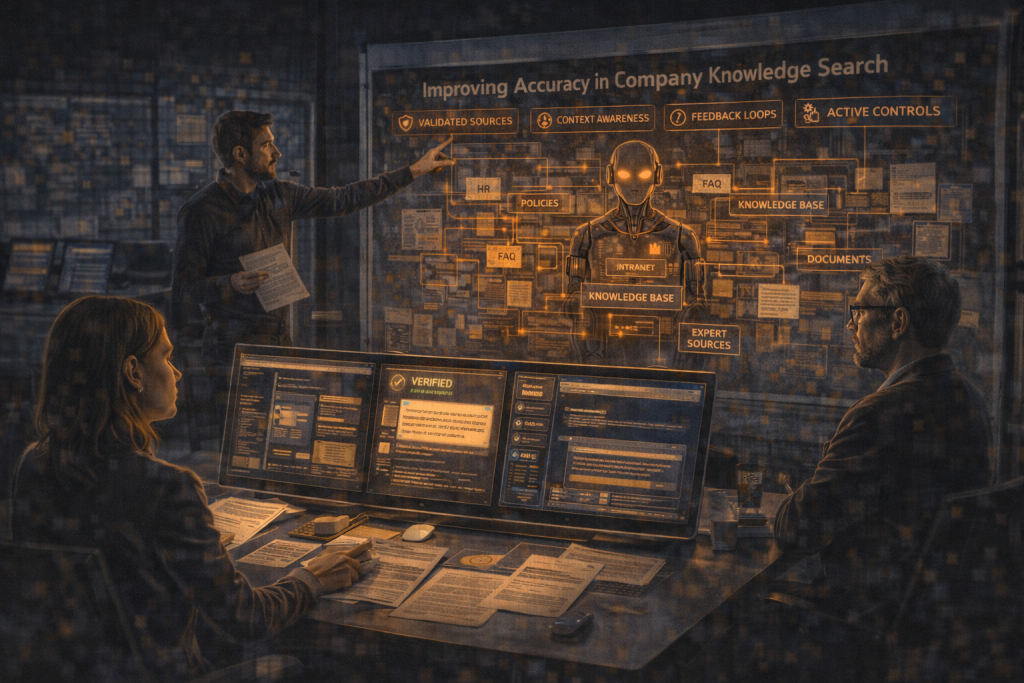

Архитектура точного knowledge-поиска

Устойчивый контур обычно состоит из семи слоев.

- Ingestion: подключение источников и нормализация форматов.

- Preprocessing: очистка, дедупликация, разбиение на смысловые блоки.

- Indexing: гибридный индекс (векторный + лексический).

- Retrieval: отбор кандидатов по интенту.

- Rerank: переоценка релевантности top-k.

- Answer generation: ответ только на основе evidence.

- Guardrails/observability: проверки, аудит и метрики.

Ключевой принцип

Модель не должна «выдумывать недостающий контекст». Если релевантных источников нет, правильное поведение — показать нехватку данных и предложить путь эскалации.

Почему гибридный поиск важен

Векторный поиск хорошо ловит смысл, лексический — точные термины, коды, артикулы и названия. В корпоративных сценариях нужно и то, и другое.

Роль цитирования

Ответ без ссылок снижает доверие. Ответ с ссылками позволяет быстро проверить корректность и ускоряет обучение команды работе с системой.

Данные и governance: фундамент качества

Точность поиска на 60–80% определяется качеством источников. Поэтому data governance — не бюрократия, а главный фактор ROI.

Что должно быть у каждого источника

- владелец и ответственный за актуальность;

- дата последней проверки;

- уровень чувствительности;

- область применимости (домен/регион/продукт).

Дедупликация и version policy

Система должна отличать действующую версию от исторической. Архив полезен для аудита, но не должен по умолчанию доминировать в выдаче.

Календарь обновлений

Для динамичных знаний нужен короткий SLA (например, 7–14 дней), для стабильных регламентов — плановая ревизия раз в квартал. Без календаря «мертвые знания» накапливаются незаметно.

Retrieval и rerank: как реально поднимать релевантность

Гибридная выборка

На первом этапе retrieval собирает более широкий пул кандидатов. Затем rerank перестраивает его под конкретный интент и контекст пользователя.

Query rewriting

Часто пользователи задают вопрос «своими словами». Переформулировка запроса в терминах домена улучшает recall и снижает промахи.

Metadata filters

Фильтры по роли, дате, продукту, региону и типу документа резко повышают качество выдачи, особенно в больших knowledge-базах.

Adaptive top-k

Одинаковое количество фрагментов на все запросы — антипаттерн. Простым вопросам достаточно малого контекста, сложным — расширенного с rerank.

Error analysis loop

Каждую неделю полезно разбирать 20–30 «плохих» запросов: где потерян контекст, где сработал не тот фильтр, где нужен новый синоним в словаре. Это дает быстрые улучшения без капитального рефакторинга.

Контроль качества ответов и уменьшение галлюцинаций

Даже хороший retrieval не гарантирует идеальный ответ. Нужен отдельный контроль генерации.

Практики, которые работают

- ответ только по retrieved evidence;

- обязательные ссылки на источники;

- confidence score и эскалация при низкой уверенности;

- политика «не знаю», если доказательной базы недостаточно;

- post-check на противоречия и policy-нарушения.

Human review для high-risk доменов

В юридических, финансовых и безопасностных вопросах финальный контроль человеком снижает стоимость ошибок и повышает доверие к системе.

Golden dataset

Нужен эталонный набор вопросов с ожидаемыми источниками и ответами. Без него команда не видит, улучшается система или просто меняет стиль ошибок.

Безопасность и доступ: кто должен видеть какие знания

Корпоративный поиск должен быть role-aware. Нельзя сначала достать документ, а потом пытаться «скрыть лишнее» в ответе.

Базовые требования

- RBAC/ABAC на этапе retrieval.

- Маскирование PII и секретов.

- Аудит: кто, когда и к каким данным обращался.

- Блокировка prompt injection через недоверенные источники.

Зачем это бизнесу

Один инцидент утечки может «съесть» весь экономический эффект проекта. Поэтому безопасность — часть ROI, а не дополнительная опция.

Метрики: как измерять точность и бизнес-эффект

Метрики retrieval

- Recall@k и nDCG.

- Доля запросов с релевантным top-1.

- Стабильность результатов по доменам.

Метрики answer-качества

- faithfulness/groundedness;

- доля ответов с корректными citations;

- доля эскалаций и повторных уточнений.

Бизнес-метрики

- время получения полезного ответа;

- снижение нагрузки на экспертов;

- сокращение времени онбординга сотрудников;

- снижение операционных ошибок.

Важно смотреть метрики в связке: рост скорости без роста качества не считается успехом.

План внедрения на 90 дней

Дни 1–15: аудит и baseline

- Определите приоритетный домен знаний.

- Соберите карту источников и владельцев.

- Зафиксируйте текущие метрики времени/качества.

Дни 16–35: ingestion и индекс

- Очистка данных, дедупликация, version policy.

- Запуск гибридного индекса.

- Первичная настройка фильтров по ролям и метаданным.

Дни 36–55: retrieval + rerank

- Настройка query rewriting и rerank.

- Тестирование на golden-наборе.

- Разбор типовых промахов и корректировки.

Дни 56–75: answer-контур и guardrails

- Включение citations и confidence.

- Политика «недостаточно данных».

- Безопасность и аудит обращений.

Дни 76–90: canary и масштабирование

- Ограниченный rollout на группу пользователей.

- Сбор feedback и weekly tuning.

- План расширения на следующий домен.

Чеклист команды

- Есть owner у каждого ключевого источника.

- Есть версия и дата актуализации документов.

- Внедрен гибридный retrieval и rerank.

- Ответы содержат ссылки на источники.

- Есть confidence и эскалация человеку.

- Права доступа проверяются до выдачи контекста.

- Есть golden dataset и регулярные quality-review.

- Считаются retrieval/answer/business метрики.

- Есть runbook на инциденты качества и безопасности.

- Существует календарь обновления знаний.

Итог

Точный поиск по знаниям компании — это конкурентное преимущество 2026 года. Он снижает операционный шум, ускоряет решения и делает знания доступными не только экспертам, но и всей организации.

Но точность не возникает автоматически. Она появляется там, где компания управляет данными, контролирует retrieval, проверяет ответы, соблюдает доступы и постоянно улучшает систему на реальных запросах.

Для бизнеса это значит простую вещь: знания начинают работать как актив, а не как архив. И именно это дает реальный экономический эффект от внедрения AI-поиска.

FAQ

Можно ли запустить точный поиск без RAG?

Можно базово, но для сложных корпоративных вопросов RAG + citations обычно дает более высокий уровень полезности и проверяемости.

Что важнее: лучшая модель или лучшие данные?

Лучшие данные и retrieval. Сильная модель не компенсирует хаос в источниках.

Как часто обновлять индекс?

По SLA источников: динамичные знания чаще, стабильные регламенты — по расписанию и при изменениях.

Нужен ли human review всегда?

Для low-risk сценариев — не всегда. Для high-risk и правовых вопросов — желательно обязательно.

Как быстро увидеть эффект?

Первые улучшения часто видны за 4–8 недель, устойчивый эффект — за 2–3 квартала при системной эксплуатации.

Ключевые термины

- Knowledge search: корпоративный поиск по внутренним знаниям и документам.

- Retrieval: извлечение релевантных фрагментов по запросу.

- Rerank: переоценка кандидатов по релевантности.

- Groundedness: опора ответа на реальные источники.

- Golden dataset: эталонный набор вопросов для оценки качества.

- RBAC/ABAC: модели ролевого и атрибутивного контроля доступа.

Читайте также

Практические кейсы: как компании поднимают точность поиска по знаниям

Кейс 1. Служба поддержки: от «поищите в базе» к answer-first

В сервисной компании сотрудники поддержки тратили много времени на поиск ответов между wiki, тикетами и внутренними инструкциями. Формально база знаний была большой, но фактически многие ответы зависели от «памяти опытного сотрудника». После запуска answer-системы с citations first-response time сократился, а зависимость от отдельных экспертов уменьшилась.

Ключевые шаги, которые дали результат:

- Очистили дубли в базе знаний и назначили владельцев разделов.

- Разделили контент на публичные и внутренние уровни доступа.

- Внедрили обязательные ссылки на источники в ответе.

- Добавили режим «не хватает данных» вместо догадок.

Главный вывод — скорость выросла не из-за «лучшей модели», а из-за дисциплины в знаниях и проверяемого формата ответов.

Кейс 2. Инженерная команда и инциденты

В DevOps/SRE-команде была типичная проблема: при инциденте инженеры тратили время на поиск похожих кейсов, runbook и решений из прошлого. После внедрения retrieval-системы по инцидент-базе и техдокументации время первичного анализа заметно снизилось. Но первая версия часто поднимала устаревшие runbook выше актуальных.

Проблему решили через version-aware ranking: документы с пометкой «актуально» и недавней валидацией получали приоритет. Параллельно добавили поле «last verified by». После этого качество ответов стабилизировалось и число «ложных рекомендаций» уменьшилось.

Кейс 3. Продажи и пресейл

В B2B-команде пресейл специалисты постоянно искали релевантные кейсы, условия интеграции и ответы на типовые возражения. Search-система с domain filters (продукт, сегмент, регион, отрасль) позволила быстрее собирать «точные» пакеты аргументов. Важно, что команда не делегировала системе финальный коммерческий ответ: агент готовил материал, эксперт проверял и адаптировал.

Такой режим показал лучший баланс скорости и качества, чем полностью автоматический генератор «коммерческих писем».

Кейс 4. Юридический контур и комплаенс

Юридические знания чувствительны к версии и формулировкам. Попытка использовать единый поиск без контроля редакций привела к конфликтующим рекомендациям. После внедрения «режима правовой точности» система стала возвращать не просто ответ, а сопоставление релевантных пунктов с указанием редакции и даты действия.

Результат — меньше ошибок интерпретации и выше доверие к системе со стороны юристов и compliance-команды.

Кейс 5. Онбординг новых сотрудников

В быстрорастущей продуктовой компании onboarding занимал слишком много времени у лидов команд. После запуска структурированного поиска новичок мог получить ответы на типовые вопросы с переходом в опорные документы. Это сократило время «ручного сопровождения» и ускорило выход на продуктивность.

Что объединяет успешные внедрения

- Узкий стартовый scope и конкретный бизнес-кейс.

- Ясные владельцы знаний и процесс обновлений.

- Прозрачный контур качества (retrieval + answer + audit).

- Разделение low-risk и high-risk сценариев.

- Постоянная обратная связь от пользователей.

Где проекты чаще всего ломаются

- Запуск на «весь контент компании» без очистки источников.

- Отсутствие метрик качества и SLA обновления.

- Слепая вера в генерацию без цитирования.

- Игнорирование прав доступа в retrieval-слое.

- Нет бюджета и ответственности на эксплуатацию после релиза.

Операционная модель: как поддерживать качество после запуска

Недельный цикл

Раз в неделю команда проверяет:

- top-20 запросов с низкой удовлетворенностью;

- ошибки retrieval (не тот источник, слабая релевантность);

- ошибки answer-генерации (искажение смысла, неполные ответы);

- сценарии, где нужно обновить документы или метаданные.

Месячный цикл

- ревизия словаря терминов и синонимов;

- аудит устаревших разделов;

- перекалибровка порогов confidence и rerank;

- проверка прав доступа и журналов аудита.

Квартальный цикл

- пересмотр целевых KPI и бизнес-эффекта;

- план расширения на следующий домен знаний;

- оценка технического долга и приоритетов платформы.

Почему без этого качество деградирует

Знания в компании живут и меняются. Если система не «подкручивается» по факту реального использования, точность падает даже при хорошей начальной настройке. Поэтому эксплуатация важнее «красивого старта».

Роль пользователей в улучшении

Полезно собирать простой feedback в интерфейсе: «ответ помог / не помог», «источник верный / неверный», «не хватает контекста». Без этого команда не видит, где именно система теряет ценность.

Экономика сопровождения

Да, сопровождение требует ресурсов. Но его стоимость обычно ниже потерь от ошибок и ручной неэффективности в старом процессе. В зрелых командах это рассматривается как часть стоимости владения knowledge-платформой (TCO), а не как «лишние расходы».

Расширенный план улучшения точности на 6 месяцев

Месяц 1: стабилизация базового домена

Сфокусируйтесь на одном домене (например, поддержка или внутренние регламенты). Доведите базовые метрики до стабильности, прежде чем расширять систему.

Месяц 2: добавление rerank и feedback-loop

На этом этапе обычно появляется заметный прирост релевантности и снижение «мимоответов».

Месяц 3: доступы и безопасность

Укрепите role-aware retrieval, аудит и контроль чувствительных данных. Это повышает доверие бизнеса и снижает риск инцидентов.

Месяц 4: масштабирование на второй домен

Примените отработанный стандарт к смежному процессу. Важно переносить именно операционную модель, а не «копировать настройки вслепую».

Месяц 5: оптимизация стоимости

Проверьте, где можно сократить latency и compute без потери качества: adaptive top-k, кеширование частых запросов, routing по сложности.

Месяц 6: стандартизация

Закрепите governance и ownership на постоянной основе. После этого knowledge-поиск становится устойчивой корпоративной функцией, а не экспериментом.

Как понять, что система зрелая

- пользователи доверяют ответам и регулярно используют систему;

- метрики качества стабильны несколько циклов подряд;

- ошибки разбираются и превращаются в улучшения, а не повторяются;

- расширение на новые домены проходит предсказуемо по времени и качеству.

Антипаттерны, которые незаметно убивают точность

Антипаттерн 1. «Сначала модель, потом данные»

Команды часто начинают с выбора модели и интерфейса, откладывая вопрос качества источников «на потом». На практике это приводит к красивому демо и слабому продакшену: модель отвечает уверенно, но на базе противоречивых или устаревших документов.

Антипаттерн 2. Отсутствие канонического источника

Если для одного процесса существуют несколько «равноправных» инструкций, система не может устойчиво выбирать верный ответ. Нужен canonical-source policy: где официальная версия, где вспомогательный контент, где архив.

Антипаттерн 3. Одинаковые настройки для всех доменов

Разные домены требуют разной тактики retrieval. Техдокументация, юридические тексты и клиентские FAQ имеют разную структуру, риски и плотность терминов. Единые настройки часто дают средний результат везде и отличный — нигде.

Антипаттерн 4. Нет режима «не знаю»

Система, которая обязана всегда отвечать, быстрее теряет доверие. В продакшене лучше честный отказ с указанием недостающих данных, чем «правдоподобная» галлюцинация.

Антипаттерн 5. Метрики только по скорости

Сокращение времени ответа без контроля качества часто маскирует деградацию. Нужен баланс метрик: релевантность, точность, полезность, эскалации, стоимость ошибок.

Антипаттерн 6. Слабая обратная связь от пользователей

Без пользовательского feedback-loop команда не видит реальные точки боли. Логи показывают техническую картину, но не всегда отражают практическую полезность ответа.

Антипаттерн 7. Нет бюджета на поддержку

Запуск без выделения ресурсов на обновления, аудит и улучшения почти гарантирует постепенную деградацию качества через 2–3 месяца.

Методика «точность в контуре»: как выстроить систему контроля

Шаг 1. Классификация запросов

Разделите запросы по типам: фактологические, процедурные, сравнительные, high-risk. Для каждого типа задайте отдельные требования к качеству и допустимой автоматизации.

Шаг 2. Требования к ответу

Определите формат «хорошего ответа»: краткий вывод, доказательная база, ссылка на источник, ограничение применимости, при необходимости — рекомендация эскалации.

Шаг 3. Контроль retrieval перед генерацией

Если retrieval не достиг порога релевантности, не запускайте генерацию как будто контекст достаточный. Лучше перейти в режим уточнения запроса или эскалации.

Шаг 4. Постпроверка ответа

После генерации проверяйте: есть ли unsupported claims, нет ли конфликтов с политиками, корректно ли отработал контроль доступа, не включены ли чувствительные данные.

Шаг 5. Разбор ошибок по категориям

Не объединяйте все ошибки в одну группу. Разделяйте их на:

- ошибка источника (данные);

- ошибка retrieval;

- ошибка ранжирования;

- ошибка генерации;

- ошибка политики доступа/безопасности.

Так быстрее понятно, где в цепочке нужен фикс.

Шаг 6. Экспериментальная дисциплина

Любое улучшение внедряйте как гипотезу: что меняем, какая метрика должна вырасти, в какой срок смотрим эффект. Без этого изменения превращаются в хаотичный тюнинг.

Шаг 7. Канареечный rollout

Новые настройки сначала проверяйте на ограниченной группе пользователей. Это снижает риск массовой деградации и дает быстрый откат при необходимости.

Рекомендации для руководителей: как принимать решения по развитию системы

1. Смотрите на тренд, а не на один спринт

В knowledge-проектах важна динамика нескольких циклов. Один хороший или плохой месяц не всегда отражает реальную траекторию.

2. Сравнивайте с альтернативой

Оценка должна учитывать не только «как работает система», но и «что происходит без нее»: ручной труд, потери времени, ошибки из-за неполной информации.

3. Не перегружайте команду метриками

Лучше 5–7 ключевых показателей, которые реально используются в решениях, чем 40 графиков без действий по результатам.

4. Инвестируйте в данные и владельцев

Каждый рубль в data governance обычно дает более устойчивый эффект, чем «гонка за следующей моделью», если базовые знания неупорядочены.

5. Фиксируйте правило остановки

У каждой инициативы должен быть критерий, при котором сценарий пересматривается или приостанавливается. Это защищает бюджет от затянувшихся проектов с низкой отдачей.

6. Думайте о масштабировании заранее

Даже успешный пилот не гарантирует успех при расширении. Нужен переносимый стандарт: процессы, роли, метрики, контроль рисков.

7. Поддерживайте культуру прозрачности

Ошибки системы не должны скрываться. Чем быстрее команда признает и разбирает промахи, тем быстрее растет качество и доверие пользователей.

Итоговая мысль: точность корпоративного поиска — это не «параметр модели», а управляемая способность организации работать со знаниями как с производственным активом.

Быстрый старт на 30 дней: минимальный рабочий контур

Неделя 1: фокус и инвентаризация

Выберите один домен с максимальной бизнес-болью: например, база поддержки или внутренние техрегламенты. Опишите основные источники данных, владельцев и частоту обновления. Не пытайтесь подключить все системы сразу — это главный источник перегруза на старте.

Неделя 2: чистка и базовый индекс

Удалите очевидные дубли, пометьте архивные документы, нормализуйте названия и ключевые метаданные. Запустите базовый индекс и проверьте, как система отвечает на top-20 реальных вопросов команды.

Неделя 3: качество и обратная связь

Добавьте простой feedback-механизм: «полезно/неполезно», «источник корректен/некорректен». Проведите разбор наиболее слабых ответов и выясните причину: источник, retrieval, ранжирование, формулировка запроса.

Неделя 4: стабилизация и правила

Внедрите минимальные guardrails: citations, режим «недостаточно данных», базовые ограничения доступа. Зафиксируйте 5–7 KPI и регулярный ритм review. На этом этапе уже можно увидеть первые результаты и принять решение о следующем домене.

Что считать успехом через 30 дней

- Система дает устойчиво полезные ответы по целевому домену.

- Пользователи реально используют поиск в рабочих задачах.

- Есть прозрачный список ошибок и план их устранения.

- Команда понимает, как масштабировать без потери качества.

Даже такой минимальный старт дает больше ценности, чем «большой запуск» без структуры и ownership.

Финальный практический вывод

Повышение точности поиска по знаниям компании — это управленческий и инженерный процесс одновременно. Технология дает инструменты, но устойчивый результат появляется только там, где есть владельцы знаний, ритм обновлений, прозрачные метрики и дисциплина разборов ошибок.

Если смотреть на систему как на «живой контур», который постоянно учится на реальных вопросах, ее ценность растет с каждым циклом. Если воспринимать ее как разовый проект, она быстро деградирует и теряет доверие пользователей.

Для компаний, которые хотят ускорять принятие решений без роста операционного риска, точный knowledge-поиск — один из самых практичных и окупаемых AI-кейсов 2026 года.

Краткий план масштабирования на следующие 2 квартала

- Квартал 1: закрепить качество в первом домене, стабилизировать retrieval-метрики, автоматизировать weekly-review.

- Квартал 1: подключить второй домен по уже проверенному стандарту (ownership, метаданные, доступы, citations).

- Квартал 2: объединить домены через общий словарь сущностей и единый портал запросов.

- Квартал 2: оптимизировать стоимость и latency: кеши, adaptive top-k, routing по сложности запросов.

- Квартал 2: внедрить расширенную аналитику качества и формальный governance-ритм на уровне руководства.

Такой темп позволяет расти без потери контроля и без «завала» команды поддержкой нестабильной системы.

В долгосрочной перспективе качество корпоративного поиска начинает влиять не только на скорость отдельных задач, но и на культуру принятия решений в компании. Когда сотрудники привыкли опираться на проверяемые источники, меньше решений принимается «по памяти» или по неполной информации. Это снижает операционные риски, ускоряет онбординг, укрепляет межкомандное взаимодействие и делает организацию более устойчивой к росту сложности. Поэтому инвестиции в точность поиска окупаются не только в KPI текущего квартала, но и в накопленной управленческой эффективности бизнеса.

Если упростить до практического правила: сначала обеспечьте точность и проверяемость в одном домене, затем переносите стандарт на другие. Не наоборот. Такой подход защищает проект от масштабирования хаоса, когда количество источников и интеграций растет быстрее, чем способность команды контролировать качество. Когда каждый новый этап проходит через одинаковый цикл — аудит, запуск, метрики, корректировки — результат становится предсказуемым. Именно предсказуемость в 2026 году отличает зрелый knowledge-контур от экспериментального ассистента.

И это дает устойчивый измеримый эффект.

Команда быстрее учится, пользователи больше доверяют системе, а бизнес получает знания в форме, пригодной для ежедневных решений.

Это и есть зрелость внедрения.