11 апреля 2026

Фундаментальные ограничения LLM: где ждать прогресса, а где нет

Автор: ТЕХЛАБА

Коротко (TL;DR)

- У больших языковых моделей есть не только инженерные, но и фундаментальные ограничения: неопределенность генерации, хрупкость к контексту и отсутствие встроенной проверки истинности.

- В 2026 году реальный прогресс достигается не «магией модели», а архитектурой вокруг нее: retrieval, валидация, рейтинги ответов, политика рисков и контроль стоимости.

- Команды, которые принимают ограничения LLM как проектные условия, строят более надежные и предсказуемые продукты, чем команды, которые пытаются «дожать промптами» все сценарии.

Содержание

- Почему тема ограничений важнее темы «новых фич»

- Какие ограничения действительно фундаментальные

- Где в 2026 году ждать прогресса

- Где не стоит ждать прорыва в ближайшем цикле

- Как проектировать продукт с учетом ограничений

- Контроль качества: метрики, тесты, красные линии

- Экономика LLM: стоимость, задержки, компромиссы

- Регуляторика и юридические риски для российского рынка

- Практический план внедрения на 90 дней

- Итог и FAQ

Почему тема ограничений важнее темы «новых фич»

На рынке ИИ часто доминирует витрина: у моделей растет окно контекста, улучшается мультимодальность, появляются новые режимы reasoning. Это важные новости, но для продуктовой команды главный вопрос звучит иначе: «Насколько предсказуемо система решает задачу пользователя и какие риски мы контролируем?» Именно здесь проявляются фундаментальные ограничения LLM. Модель может показать блестящую демо-сессию и при этом провалиться на реальных данных, где есть шум, неоднозначность, устаревшие документы и противоречивые источники.

В 2026 году зрелые команды перестали строить стратегию вокруг бенчмарков и перешли к инженерной дисциплине: фиксируют целевой SLA по точности, ограничивают зону автономии агента, внедряют двухуровневую валидацию ответов и заранее считают «стоимость ошибки». Такой подход делает ограничения не препятствием, а рамкой проектирования. Если рамка принята, можно стабильно развивать продукт; если игнорировать ее, любой рост функциональности превращается в накопление скрытого долга.

Простой маркер зрелости: команда умеет объяснить, где модель точно полезна, где полезна частично, а где не должна принимать решение без человека. Там, где такого разделения нет, обычно начинаются ожидания «универсального ИИ», затем растет число инцидентов, и проект откатывается к ручным процессам.

Какие ограничения действительно фундаментальные

1) Вероятностная природа генерации

LLM предсказывает следующий токен по вероятности, а не извлекает «истину» из встроенной базы фактов. Из этого следует, что даже на знакомой задаче модель может выдавать разные варианты ответа, особенно при сложном контексте, неполных данных и конкурирующих интерпретациях. Температура, top-p и другие параметры лишь регулируют распределение, но не делают поведение строго детерминированным в семантическом смысле.

2) Хрупкость к формулировке и контексту

Незначительное изменение формулировки запроса, порядка блоков в контексте или структуры системного промпта способно заметно менять результат. Это особенно критично в enterprise-сценариях, где поток запросов массовый и неоднородный: пользователи пишут коротко, с ошибками, часто без предметного контекста. Следовательно, «идеальный промпт» не решает проблему в целом; нужна инфраструктура нормализации и маршрутизации запросов.

3) Отсутствие встроенной гарантии фактической корректности

Модель может уверенно формулировать неправду. Галлюцинации становятся реже при правильной архитектуре, но не исчезают полностью. Поэтому любой сценарий с юридическими, финансовыми или операционными последствиями обязан иметь внешний контур проверки: retrieval с доверенными источниками, правила верификации и механизм отказа от ответа при низкой уверенности.

4) Ограниченная прозрачность внутренних причин решения

Интерпретируемость LLM остается частичной. Мы видим вход и выход, но не получаем полноценного трассируемого доказательства «почему принято именно такое решение». Для аудита это создает трудности: приходится строить доказуемость через внешние артефакты — ссылки на источники, логи шагов агента, контрольные политики.

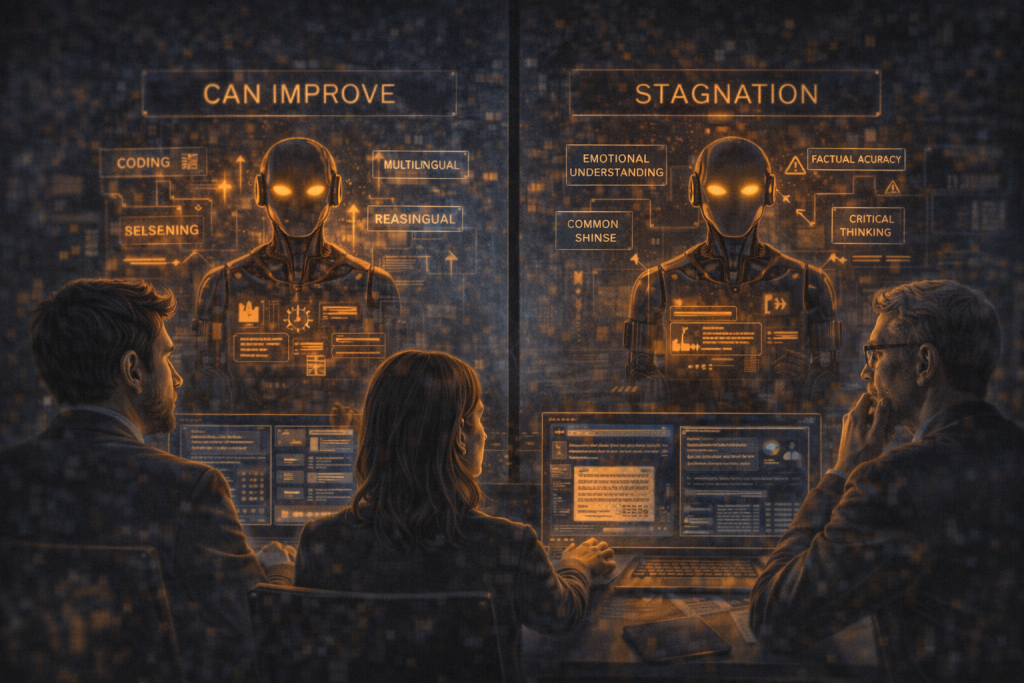

Где в 2026 году ждать прогресса

Прогресс наиболее заметен в трех областях. Первая — качество инструментов вокруг модели: реранкеры, фильтры фактической согласованности, автоматические проверки структуры ответа, безопасные вызовы инструментов. Это не «магия новой модели», но именно такие компоненты дают скачок в качестве продукта.

Вторая область — узкие доменные сценарии с хорошо структурированными данными. Там, где есть стабильная терминология, документированные процессы и измеримые критерии успеха, LLM уже сегодня дает предсказуемую пользу: поддержка клиентов, внутренний поиск, черновики документов, помощь в код-ревью, triage инцидентов.

Третья область — удешевление операций через маршрутизацию. Компании научились не отправлять каждый запрос в самую дорогую модель. Сначала идет легкая классификация задачи, затем подбор оптимального маршрута: «маленькая модель + retrieval» для типовых вопросов, «большая модель + инструменты» для сложных кейсов. Это снижает стоимость без потери качества и открывает масштабирование.

Именно поэтому стратегический фокус смещается с «поиска самой умной модели» на «проектирование целой цепочки принятия решения». В такой цепочке модель — ключевой, но не единственный элемент.

Где не стоит ждать прорыва в ближайшем цикле

Не стоит ожидать полной автономности агентов в сложных многошаговых бизнес-процессах, где каждая ошибка дорогая и требует юридически значимого обоснования. Да, агенты могут автоматизировать отдельные этапы, но «полный автопилот» остается рискованным из-за накопления мелких неточностей и каскадных ошибок.

Также не стоит ждать универсальной модели, одинаково эффективной во всех доменах. На практике domain adaptation и качество контекста по-прежнему решают больше, чем «универсальный интеллект». Команда, которая не инвестирует в данные и процессы, не получит устойчивого результата даже на самой сильной модели.

Еще один переоцененный вектор — надежда на то, что рост контекстного окна сам устранит проблему качества. Большой контекст полезен, но одновременно увеличивает риск шумов, конфликтов источников и ложных корреляций. Без строгой селекции и иерархии документов это превращается в «дорогую неопределенность».

Как проектировать продукт с учетом ограничений

Граница ответственности модели

Первое решение — четко разделить, что модель может решать самостоятельно, а что требует подтверждения. Например, формирование черновика письма — автономно, публикация юридического ответа клиенту — только после валидации человеком. Такие границы оформляются как policy-as-code и проверяются автоматически на каждом релизе.

Архитектура «retrieval-first»

Для корпоративных сценариев базовый паттерн: сначала подбор релевантных источников, затем генерация с обязательными ссылками на эти источники. Запрет на «свободный ответ без источников» снижает риск галлюцинаций и делает результат проверяемым. Дополнительно вводится scorer уверенности: если показатель ниже порога, система не фантазирует, а честно просит уточнить вопрос.

Промпт как код, а не как ручная настройка

Системные инструкции, формат ответа и защитные правила должны храниться в репозитории, версионироваться и проходить тесты. Это убирает зависимость от «человека, который помнит рабочий промпт» и позволяет делать безопасные изменения через pull request и review.

Антихрупкость через fallback

Если основной маршрут не прошел проверки, система должна переключаться на безопасный fallback: более строгий шаблон ответа, более простую модель, ручную эскалацию. Такой дизайн предотвращает эффект «все или ничего» и удерживает сервис в предсказуемом состоянии даже при деградации компонента.

Контроль качества: метрики, тесты, красные линии

Метрики нужно делить минимум на четыре группы: продуктовые, качественные, эксплуатационные и рисковые. К продуктовым относятся конверсия задачи, доля успешно закрытых обращений, снижение времени до ответа. К качественным — factual precision, citation coverage, rate отказов по политике. К эксплуатационным — задержки, доступность, стоимость на запрос. К рисковым — доля потенциально опасных ответов, нарушения регуляторных ограничений, инциденты безопасности.

Тестирование должно включать «живой» набор кейсов компании, а не только общие датасеты. Обязателен adversarial-набор: провокационные запросы, попытки prompt injection, конфликтующие документы, устаревшие регламенты, неоднозначные формулировки. Только так можно увидеть реальные границы системы.

Красные линии фиксируются заранее: например, модель не имеет права выдавать юридические трактовки без ссылки на официальный источник; не может публиковать персональные данные; не может принимать действия с финансовыми последствиями без подтверждения. В продакшене эти ограничения enforce-ятся технически, а не «на уровне договоренности».

Экономика LLM: стоимость, задержки, компромиссы

Одна из самых недооцененных проблем — «тихий рост себестоимости». Пока система в пилоте, это не видно. Но после масштабирования на десятки тысяч запросов в день стоимость промптов, retrieval, реранкинга и дополнительных проверок становится заметной строкой бюджета. Поэтому уже на старте нужны лимиты: максимальная длина контекста, ограничения на число перезапросов, SLA по времени и стоимости ответа.

Полезная практика — трехступенчатая маршрутизация. Сначала классификатор определяет тип запроса и уровень риска. Затем выбирается маршрут: легкий, стандартный или усиленный. Усиленный маршрут включает дорогие проверки и применяется только там, где цена ошибки высока. Это позволяет держать качество там, где оно критично, и не переплачивать в массовых простых сценариях.

Нельзя забывать и про стоимость поддержки: мониторинг, расследование инцидентов, обновление индексов знаний, переоценка промптов после изменений в процессах компании. Экономически устойчивое решение — это не просто «дешевый токен», а управляемая операционная модель на горизонте года.

Регуляторика и юридические риски для российского рынка

При работе с корпоративными данными необходимо учитывать требования законодательства РФ в части персональных данных, локальных политик хранения и контроля доступа. Если в контур попадают персональные или коммерчески чувствительные сведения, требуется строгая сегментация прав, журналирование действий и понятные сроки хранения.

Для контента, который может трактоваться как рекомендация или экспертное заключение, критично добавлять прозрачные оговорки о характере ответа и источниках. Это особенно важно для финансовых, медицинских и правовых тем. Система должна уметь отказать в небезопасном запросе и перенаправить пользователя к официальным каналам.

Отдельный слой риска — интеграции со сторонними сервисами и внешними API. Нужно заранее определить, какие данные можно передавать вовне, а какие должны оставаться в изолированном контуре. На практике это оформляют через data classification, маскирование полей и policy gateway на уровне исходящих вызовов.

Практический план внедрения на 90 дней

Недели 1-2: границы и риск-модель

Определите 3-5 сценариев, где ИИ дает измеримую пользу, и явно исключите зоны высокого риска. Зафиксируйте KPI и пороги качества. Назначьте владельцев по данным, безопасности и продукту.

Недели 3-5: данные и retrieval

Подготовьте источники знаний: удалите дубли, отметьте устаревшие документы, назначьте приоритеты. Постройте базовый retrieval-контур, добавьте логирование и рейтинг релевантности. Сформируйте тестовый набор реальных пользовательских вопросов.

Недели 6-8: политика ответов и валидация

Внедрите шаблоны ответа с обязательными ссылками на источники. Добавьте классификацию риска запроса и fallback-ветки. Запустите adversarial-тесты, особенно на prompt injection и конфликты источников.

Недели 9-12: пилот и операционная модель

Запустите ограниченный пилот на группе пользователей. Измеряйте качество по неделям, анализируйте инциденты, корректируйте маршрутизацию. После стабилизации зафиксируйте runbook: кто реагирует на деградацию, как откатывать изменения, как обновлять знания и как проверять релизы.

Итог

Фундаментальные ограничения LLM не исчезнут «в следующем релизе модели». Но это не плохая новость: они уже достаточно понятны, чтобы строить надежные продукты. В 2026 году выигрывают команды, которые проектируют систему целиком — от данных и retrieval до валидации, метрик и политики рисков. Такой подход превращает ИИ из нестабильного эксперимента в управляемый производственный инструмент.

FAQ

Можно ли обойтись без retrieval и просто улучшать промпт?

Для простых задач — иногда да. Для корпоративных сценариев с требованиями к точности и проверяемости — нет, retrieval обязателен.

Нужно ли сразу обучать свою модель?

Чаще всего нет. Сначала стоит выжать максимум из архитектуры и данных. Обучение имеет смысл, когда бизнес-кейс стабилен и вы точно понимаете, что именно хотите улучшить.

Как понять, что пилот готов к масштабированию?

Когда метрики качества и стоимости стабильно держатся в целевых коридорах, а runbook покрывает инциденты и обновления без ручного «героизма» команды.

Ключевые термины

- Retrieval-first architecture

- Factual precision

- Prompt injection

- Policy-as-code

- Fallback routing

- Total cost of ownership (TCO)

Читайте также

Практика: почему «хороший ответ в демо» не равен «надежный ответ в продакшене»

В демонстрации обычно контролируется почти все: вопрос задан в удобной форме, документы заранее подготовлены, контекст чистый, а пользователь не пытается сломать систему. В продакшене картина иная. Пользователь может задать несколько задач в одном запросе, дать неполные данные, противоречивые вводные и ожидать точного результата за секунды. В таких условиях модель без архитектурной обвязки начинает колебаться: иногда отвечает отлично, иногда пропускает критичную деталь.

Стабильность достигается, когда система умеет «сужать свободу» модели: сначала извлечь релевантные источники, затем сформировать ответ в заданном формате, затем прогнать через проверку фактов и политику безопасности. Этот конвейер снижает вариативность и делает качество управляемым. Именно поэтому зрелые команды обсуждают не «какая модель лучшая», а «какой у нас pipeline и где контрольные точки».

Еще одна типичная ошибка — оценка только средней точности. В реальном бизнесе важны хвостовые риски: редкие, но дорогие ошибки. Если система иногда выдает опасный ответ в чувствительном сценарии, это сильнее влияет на бизнес, чем общее улучшение среднего качества на несколько процентов.

Архитектурный шаблон для устойчивых LLM-сервисов

Рабочий шаблон в 2026 году выглядит так: входной запрос проходит нормализацию, затем классификацию намерения и риска, после чего отправляется на retrieval. Из retrieval берется ограниченный набор источников с оценкой релевантности. Генератор формирует черновик ответа строго в целевом формате. Далее применяется слой валидации: проверка ссылок, соответствия политике, запретов на небезопасные действия, детектор потенциальных галлюцинаций. Только после этого ответ отдается пользователю.

Если валидация не проходит, срабатывает fallback-ветка: запрос переформулируется, контекст сокращается, маршрут переключается на более надежную модель или на сценарий «честный отказ с рекомендацией действий». Такой подход психологически непривычен, потому что кажется «слишком осторожным», но именно он поддерживает доверие к продукту и снижает операционные риски.

Важная деталь — наблюдаемость. Каждая стадия должна писать структурированные логи: версия промпта, источники, оценки реранкера, итоговый scorer, причина отказа или эскалации. Без этих данных невозможно понять, где именно деградировала система и как вернуть качество без длительных экспериментов вслепую.

Управление знаниями: почему качество базы важнее размера

Многие команды начинают с максималистской идеи: загрузим в индекс все документы, письма, регламенты и заметки. На практике это почти всегда ухудшает результат. Избыточный и несогласованный корпус создает противоречия, повышает шум в retrieval и приводит к ответам «впечатляющим, но неверным». Поэтому стратегия должна быть обратной: сначала критичные источники и строгие правила жизненного цикла документов.

Минимальный набор правил: у каждого документа есть владелец, дата последнего подтверждения актуальности и область применения. Устаревшие версии архивируются и исключаются из стандартного retrieval. Для спорных тем задается иерархия приоритетов, чтобы система не смешивала внутренние черновики с действующими регламентами. Дополнительно полезно вводить «белые списки» источников для чувствительных сценариев.

Сильный эффект дает семантическая разметка: выделение сущностей, ролей, статусов, юридических оговорок и версий. Тогда retrieval опирается не только на «похожесть текста», но и на смысловые ограничения, что заметно снижает риск неверной интерпретации.

Prompt injection и скрытые атаки на контекст

С ростом агентных сценариев prompt injection стал одним из ключевых рисков. Проблема в том, что вредоносная инструкция может быть встроена не только в пользовательский запрос, но и в источник контекста: документ, веб-страницу, тикет, заметку в базе знаний. Если система без проверки «доверяет» контексту, она может выполнить нежелательное действие или исказить ответ.

Защита строится многоуровнево. На входе — фильтры токсичных и манипулятивных инструкций. На уровне retrieval — пометка источников по уровню доверия. На уровне генерации — жесткое разделение ролей: системные правила имеют приоритет над любым внешним текстом. На выходе — проверка на утечку секретов и несанкционированные действия. Для агентов добавляется sandbox-песочница и ограничение прав инструментов по принципу наименьших привилегий.

Критично регулярно прогонять red-team сценарии. Реальные атаки меняются быстро, и статический набор проверок устаревает. Команда должна обновлять набор инъекций так же системно, как обновляет тесты безопасности API.

Роль человека в контуре: где Human-in-the-loop обязателен

Есть три уровня участия человека. Первый — верификация высокорисковых ответов перед отправкой пользователю. Второй — разбор инцидентов и корректировка правил системы. Третий — регулярная калибровка качества на контрольной выборке. Если убрать хотя бы один уровень, качество начинает медленно, но стабильно деградировать.

Важно, чтобы участие человека было не «ручным спасением» каждый раз, а спроектированным процессом. Для этого нужен интерфейс ревью: видно вопрос, использованные источники, промежуточные проверки и причины, почему модель приняла то или иное решение. Тогда эксперт тратит минуты на корректировку, а не часы на расследование.

В зрелых командах результат ревью возвращается в систему как обучающий сигнал для правил маршрутизации и валидации, а не только как разовый фикс ответа. Это превращает человеческую экспертизу в масштабируемый актив.

DevOps и MLOps для LLM: что должно быть автоматизировано

Для LLM-продуктов уже недостаточно «задеплоить сервис». Нужен полный цикл: контроль версий промптов и политик, автоматические regression-тесты на эталонном наборе, мониторинг дрейфа качества, алерты на рост стоимости и задержек, безопасный rollback на предыдущую конфигурацию. Без этого обновления модели превращаются в рискованную операцию.

Обязательный элемент — канареечные релизы. Новая версия запускается на небольшой доле трафика, где сравниваются ключевые метрики с базовой версией. Если видно ухудшение factual precision или рост отказов, релиз автоматически останавливается. Это снижает вероятность массового ухудшения качества после «косметического» изменения промпта или параметров retrieval.

Отдельно стоит внедрить бюджетные guardrails: лимиты на токены, верхние пороги по стоимости и механизмы деградации с сохранением функциональности. Например, при превышении лимита система временно переводит часть запросов в более легкий маршрут с коротким контекстом.

Как выбирать use-case для LLM, чтобы не сжечь бюджет

Лучшие сценарии для старта имеют три признака: повторяемая задача, измеримый результат и доступные качественные данные. Если задача творческая, размытая и без критериев оценки, проект почти гарантированно уйдет в бесконечные дискуссии про «вкус ответа». Поэтому полезно начинать с процессов, где есть понятные SLA: внутренний поиск знаний, triage обращений, черновики типовых документов, помощь оператору поддержки.

Плохие стартовые сценарии — там, где модель должна принимать окончательные решения с юридическими последствиями и где нет надежного механизма валидации. В таких кейсах лучше сначала внедрять ассистивный режим: модель готовит варианты, а решение принимает человек. Это дает быстрый эффект без чрезмерного риска.

Также стоит заранее определить «критерий остановки». Если после определенного числа итераций метрики не выходят на целевой уровень, команда фиксирует результат, ограничивает область применения или закрывает инициативу. Такой подход защищает от затяжных пилотов без бизнес-ценности.

Сценарии отказа: что делать, когда модель ошибается системно

Системная ошибка отличается от разовой: она повторяется на классе запросов и связана с архитектурой, а не с конкретной формулировкой. Для таких случаев нужен аварийный протокол. Сначала команда изолирует проблемный маршрут и переводит его в безопасный режим. Затем собирает репрезентативные примеры, проводит root cause analysis и определяет точку вмешательства: retrieval, промпт, policy, данные или модель.

После фикса важно не просто вернуть сервис, а закрепить изменение тестами, чтобы инцидент не повторился в следующем релизе. Если этого не сделать, проблема возвращается циклически и подрывает доверие пользователей.

Хорошая практика — вести «паспорт инцидента» с шаблоном: что произошло, как обнаружили, какие метрики пострадали, какой временный обход применили, какой постоянный фикс внедрили. Такой архив ускоряет обучение команды и улучшает качество инженерных решений.

Дорожная карта на 12 месяцев

Квартал 1: фокус на надежность базового контура — retrieval, валидация, observability, базовые guardrails. Квартал 2: расширение на смежные сценарии, где можно переиспользовать ту же архитектуру. Квартал 3: оптимизация стоимости, маршрутизация по риску и углубление red-team тестов. Квартал 4: интеграция в ключевые бизнес-процессы с четкими владельцами и SLA.

Важно, чтобы рост функциональности не опережал зрелость платформы. Если foundation слабый, каждый новый сценарий множит долг. Если foundation устойчивый, добавление сценариев становится дешевле и быстрее. Это и есть главный признак зрелого LLM-направления в компании.

На горизонте года ключевая цель — не «самая умная модель», а предсказуемая система, которая дает стабильную ценность и не разрушает операционные процессы. Такой фокус позволяет избежать разочарования после периода хайпа и перевести ИИ в режим регулярной производственной эффективности.

Кейсы: где ограничения LLM проявляются особенно ярко

В технической поддержке часто возникает иллюзия «вопросы однотипные, значит модель справится без проблем». На практике самые затратные обращения как раз нетиповые: неполные логи, скрытые зависимости, несовместимость версий, необычные условия эксплуатации. Если ассистент не умеет явно обозначать границы уверенности и не запрашивает недостающие данные, качество ответа быстро падает.

Во внутреннем поиске знаний ограничение проявляется иначе: модель может сделать убедительный синтез, но опереться на документ, который уже неактуален. Поэтому для знаний критично версионирование, срок действия и маркировка «официального источника». Без этого пользователь получает красивый, но потенциально опасный ответ.

В разработке ПО LLM хорошо помогает с черновиками кода, тестами и объяснениями. Но без проектных ограничений она склонна предлагать решения, не учитывающие архитектурные стандарты команды. Поэтому полезно подключать контекст репозитория, coding guidelines и автоматические проверки линтерами и тестами до принятия ответа в работу.

Частые ошибки внедрения и как их избежать

Ошибка №1 — запуск без четкой метрики успеха. Если команда не знает, что именно улучшает, она не поймет, работает ли решение. Ошибка №2 — смешение пилотных и боевых данных без политики доступа, что создает риск утечек. Ошибка №3 — попытка решить все одной моделью без маршрутизации и уровней риска.

Ошибка №4 — отсутствие процесса актуализации базы знаний. Даже качественная модель бесполезна, если контекст устарел. Ошибка №5 — недооценка тестирования негативных сценариев: инъекций, конфликтов источников, неполных запросов, атак на инструменты агента. Ошибка №6 — зависимость от «ручных героев», когда стабильность держится на одном эксперте, а не на воспроизводимом процессе.

Противоядие простое: политика рисков, автоматизированные тесты, прозрачные логи, регулярный review метрик, назначенные владельцы по данным и качеству, а также понятный процесс релизов с канареечным контролем.

SEO и контент-стратегия для материалов об LLM

Чтобы материал стабильно собирал органический трафик, важно закрывать одновременно информационный и практический интент. Пользователь ищет не только «что такое ограничение LLM», но и «что делать в моей команде завтра». Поэтому структура лонгрида должна включать определения, сравнение подходов, чеклисты внедрения и раздел с типовыми вопросами.

С точки зрения онпейдж-SEO работают понятные подзаголовки, естественные ключевые фразы, внутренняя перелинковка на смежные темы (RAG, prompt injection, observability, LLMOps), а также обновляемые практические блоки. Для доверия полезно указывать дату актуализации и кратко описывать, что изменилось в версии материала.

Главный принцип: не гнаться за плотностью ключевых слов. Для технологической аудитории намного важнее точность терминов, связность аргументации и применимость рекомендаций. Такой контент дольше живет в выдаче и лучше конвертируется в возвратные визиты.

Заключение для руководителей команд

Если смотреть на LLM как на «коробку с ответами», разочарование неизбежно. Если смотреть как на компонент сложной системы принятия решений, ограничения становятся управляемыми. Руководителю важно требовать от команды не демонстраций, а доказуемости: какие сценарии покрыты, где проходят границы риска, какие метрики подтверждают пользу, как устроен откат при деградации и сколько стоит каждый уровень качества.

В зрелом подходе стратегия формулируется так: сначала надежный фундамент и контроль рисков, затем масштабирование функциональности. Это может выглядеть медленнее на старте, но в течение года дает лучший результат по скорости изменений и качеству сервиса. Именно такие команды превращают ИИ в устойчивое конкурентное преимущество, а не в источник постоянных кризисов.

Фундаментальные ограничения LLM не отменяют ценность технологии. Они просто требуют инженерной честности, дисциплины и системного проектирования. И это хорошая новость: все перечисленные практики доступны уже сегодня и дают измеримый эффект без ожидания «следующей революционной версии» модели.

Дополнение: контроль после релиза

После публикации обновления важно минимум две недели отслеживать метрики качества по сегментам пользователей, сценариям и источникам данных. Такой пострелизный контроль помогает вовремя заметить дрейф, локализовать причину и внести корректировки до того, как деградация станет заметной для всей аудитории.